大型語言模型(LLM),例如 OpenAI 的 GPT 系列和谷歌的 BERT已成為推動許多應用的基礎技術,從自動化客戶服務到高級研究工具。

訓練這些模型需要大量的資金投入,主要是因為需要大量的參數空間和計算能力。訓練 LLM 需要使用高端 GPU 或專用 AI 硬件,這可能非常昂貴。

例如,單獨訓練 GPT-3 的計算成本為估計范圍從約 50 萬美元到高達 460 萬美元不等,具體取決于培訓過程中實現的具體硬件和運營效率。

本文探討了將這些生成式 AI 模型付諸實踐所涉及的多方面費用,主要關注基礎設施需求、數據管理以及云計算日益重要的作用。繼續閱讀,全面了解當今影響大型語言模型開發的財務和后勤考慮因素。

什么是大型語言模型?

LLM 旨在模仿人類智能。它們接受大量數據集的訓練,這些數據集包含來自書籍、網站和其他數字內容的文本。

它們學習語言的統計特性,從而能夠根據收到的輸入生成連貫且與上下文相關的文本。例如,GPT 等模型經過各種互聯網文本的訓練,可以生成在許多上下文和主題中模仿人類寫作風格的文本。

這些模型使用注意力和上下文感知等機制來處理相互關聯的文本部分。這使得模型能夠根據文本其他部分提供的上下文,以不同的方式衡量輸入文本不同部分的重要性。這種上下文感知對于理解和生成連貫且適合上下文的響應至關重要。

BERT就是一個例子,因為它可以通過雙向閱讀文本(從左到右和從右到左)來理解句子中單詞的上下文,這比以前單向處理文本的模型有了很大的進步。這種能力使得 BERT 特別適合那些需要深入理解語言上下文的任務,例如回答問題或對文本進行分類。

大型語言模型的應用范圍十分廣泛,涉及醫療保健等各個行業,可以預測患者的結果基于歷史數據,進行娛樂,為虛擬角色生成逼真的對話。

現在,我們來討論一下使用云服務培訓大型語言模型的成本。

使用云服務器訓練大型語言模型的成本

由于多種原因,人工智能開發越來越多地轉向云平臺,包括GPU短缺,云服務是培訓 LLM 最簡單、最可靠的方式之一。它們的可擴展性對于 AI 培訓周期不斷變化的需求也非常出色。

NVIDIA 首席執行官黃仁勛在NVIDIA GTC 2024例如,使用 25,000 塊基于 Ampere 的 GPU(很可能是 A100)訓練 GPT-MoE-1.8T 模型需要 3 到 5 個月的時間。使用 Hopper(H100)進行同樣的訓練則需要大約 8,000 塊 GPU,耗時 90 天。

由于需要大量資金投入,大多數用戶不會從頭開始訓練 LLM。相反,他們會利用其他公司或組織提供的預訓練模型(如 ChatGPT 或 Llama2)。

使用此方法培訓 LLM 的方法有兩種:

托管您自己的模型。

按代幣付費

讓我們看一下每種方法。

在云中托管模型

捷智算平臺提供全面的套件,支持整個機器學習生命周期——從數據存儲和計算到部署和管理。然而,基于云的培訓的便利是有代價的。

在訓練大型模型或具有數十億個參數的模型(如 GPT-3B 或 Falcon 180B)時,成本不僅僅在于 GPU(例如 A100)。在云服務環境中,您還需要考慮:

虛擬 CPU(vCPU)管理模型訓練任務的執行。

內存(RAM)用于存儲計算的即時數據。

存儲成本,包括保存模型的參數和訓練數據。

這些組件中的每一個都會增加成本,優化資源使用以有效管理費用至關重要。云提供商通常根據計算時間、分配的內存量以及存儲或傳輸的數據量收費,這使得訓練大型 AI 模型的成本特別高。

在捷智算平臺上訓練大型語言模型的成本

讓我們分析一下在大型模型上訓練 LLM 時如何實現這一點:

在撰寫本文時,A100在捷智算平臺上起價為每小時 1.67 美元或每月 1,219.94 美元。如果考慮其他成本(例如所需的 vCPU 和內存),則每個費用均根據位置收費。

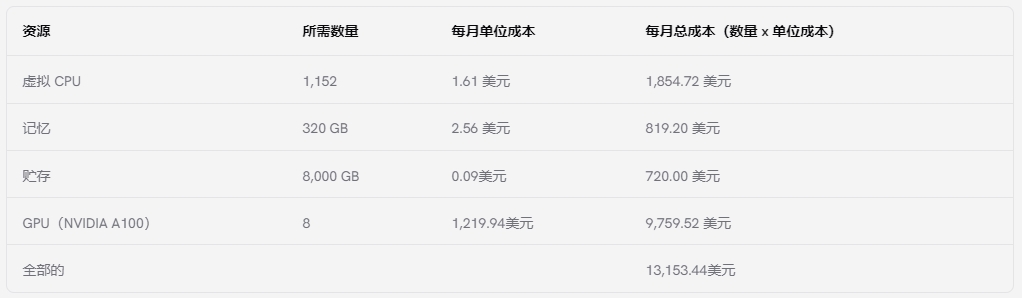

使用捷智算平臺上 A100 GPU 的中位數價格,以下是每種所需資源的成本:

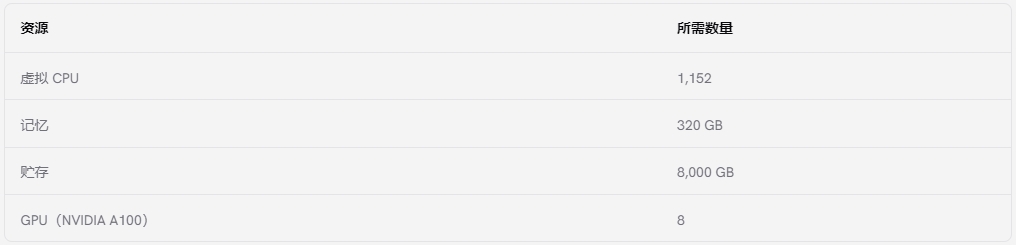

建議使用多個 GPU 以獲得最佳效果。根據在 AWS 上訓練相同模型的默認實例,這是在捷智算上訓練 Falcon 180B 所需的建議數量:

上述配置與 AWS 上用于在同一模型上訓練 LLM 的默認配置非常相似。要在捷智算上使用此配置,每月總計將超過 13,000 美元。以下是明細:

請記住,訓練 LLM 可能需要數月時間,因此這筆費用會隨著時間的推移而增加,特別是當訓練涉及對大量數據集進行多次迭代時。CUDO Compute 定價極具競爭力,因此其他平臺上的計算成本通常更高。例如,在 AWS 上使用具有類似配置的實例(ml.p4de.24xlarge)每月將花費超過 23,000 美元。

考慮到成本,一些用戶可能更愿意按代幣付費。具體操作如下。

按照代幣(PPT)付費獲取大型語言模型 (LLM) 訪問權限

培訓和維護 LLM 的高成本導致了按代幣付費 (PPT) 模式的興起,用于訪問這些強大的語言模型。其工作原理如下:

OpenAI 和 Google AI 等公司利用通過 API 公開的大量數據集對大量 LLM 進行預訓練。這樣一來,開發者和企業就可以使用這些模型(例如 GPT-3 或類似模型),而無需承擔訓練此類模型的高昂成本和技術挑戰。

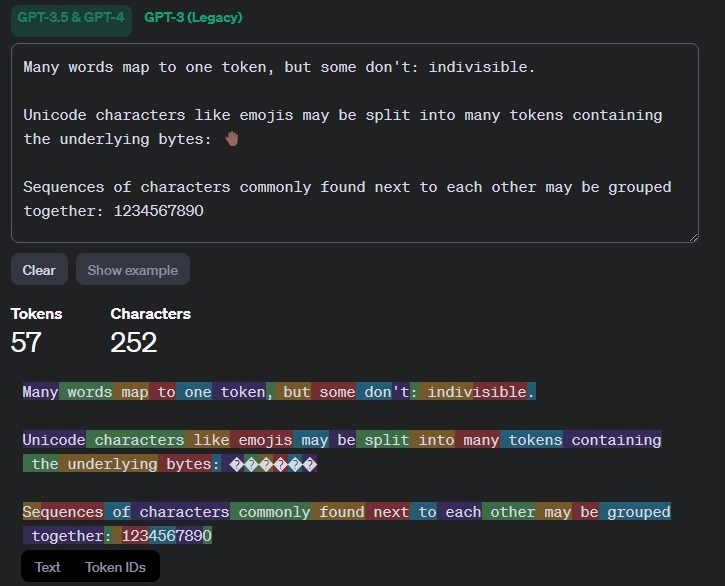

用戶無需承擔培訓和基礎設施的前期成本。相反,他們只需根據 LLM 在完成文本生成、翻譯或代碼編寫等任務時處理的標記數量(大致相當于單詞或子單詞)支付費用。

對于不需要大量使用 LLM 的任務,PPT 模式比內部培訓更具成本效益。用戶只需為實際使用的資源付費。

按代幣付費的好處:

降低成本:該模型消除了對硬件、軟件和訓練數據的前期投資。

可擴展性:用戶可以根據需要輕松地擴大或縮小 LLM 的使用量,只需為他們消耗的代幣付費。

可訪問性: PPT 允許更廣泛的用戶和小型公司訪問 LLM,而無需承擔高昂的內部培訓費用。

為何培養大型語言模型 (LLM) 這么貴?

訓練大型語言模型 (LLM) 需要巨大的計算能力。這些模型有數十億個參數,訓練它們需要在強大的硬件(如 GPU)上運行數天甚至數月的復雜算法。提供這種基礎設施的云服務成本高昂,計算時間、存儲空間和數據傳輸等因素都會增加總體費用。

按代幣付費的注意事項:

定價模式:不同的提供商根據特定的 LLM 模型和使用的令牌量提供不同的定價結構。有些提供商可能會為更高的使用層級提供折扣。

控制有限:與內部訓練相比,用戶對預訓練模型所使用的訓練數據和具體配置的控制較少。

延遲:根據響應的長度以及模型在后端硬件上每秒可以生成的令牌數,用戶在通過 API 與 LLM 交互時可能會遇到一些延遲。

對于大多數希望使用 LLM 而又不想承擔內部培訓的巨大財務負擔的用戶來說,按代幣付費模式是一種極具吸引力的替代方案。然而,在選擇此方法之前,了解定價結構、控制限制和潛在的延遲問題非常重要。

控制大型語言模型培訓成本的步驟

雖然大型語言模型的成本仍然很高,但有一些策略可以優化資源利用率并降低費用:

1.實施模型優化技術:

模型架構選擇:仔細選擇模型架構,以平衡復雜性和所需性能。較小的模型通常需要較少的資源來訓練。修剪技術可以進一步減小模型大小,而不會造成明顯的準確度損失。

訓練數據優化:確保您的訓練數據質量高且與當前任務相關。過濾掉不相關的數據可以縮短訓練時間并降低計算成本。

知識提煉:知識提煉在這個過程中,訓練一個較小的“學生”模型來復制較大的“老師”模型的性能。這使得學生模型能夠從老師的知識中受益,而無需從頭開始訓練較大的模型所需的大量計算資源。由于更緊湊,學生模型的部署效率更高,尤其是在資源受限的環境中。

混合精度訓練: 混合精度訓練在單個訓練工作流程中使用半精度 (FP16) 和單精度 (FP32) 浮點格式。目標是加快訓練速度并減少內存使用量,同時保持模型的準確性和穩定性。使用損失縮放等特殊技術來管理降低的數值精度對訓練動態的影響。這可以在兼容硬件(如 NVIDIA H100 GPU)上完成。

2.考慮硬件優化:

高效的硬件利用率:監控訓練期間的資源利用率。梯度累積等技術可以幫助實現更高的 GPU 利用率,從而縮短訓練時間并降低成本。

選擇合適的硬件:選擇能夠滿足您特定訓練需求且性價比最高的硬件。考慮使用較新的 GPU,例如 H100,其性能比前幾代產品有顯著提升。

云服務優化:探索不同的云服務提供商和定價模式。與預留實例相比,按需定價可能會節省成本,具體取決于您的訓練計劃可預測性。

我可以自己培養大型語言模型嗎?

從技術上講,您可以訓練自己的大型語言模型 (LLM),但成本可能非常高。訓練需要大量計算資源(強大的 GPU)和大量數據。云服務提供了這種基礎設施,但成本可能高達數百萬美元,具體取決于模型大小和訓練時間。

3.優化訓練配置:

超參數調整:嘗試不同的學習率、批量大小和其他訓練超參數,以找到平衡訓練速度和準確性的最佳配置。

提前停止:實施技術來監控訓練進度,并在達到所需的性能水平后停止訓練。這可以避免不必要的資源消耗。

梯度檢查點:在訓練期間定期保存模型狀態。這樣,您可以在發生硬件故障或中斷時從檢查點恢復訓練,從而節省時間和資源。

4.考慮使用混合專家模型:

專用子網:專家匯聚(MoE)架構將訓練工作量分配給多個專門的子網絡或“專家”。每個專家專注于數據的一個特定子集,與傳統模型相比,這有可能縮短訓練時間并提高效率。技術集。

減少計算負荷:通過將訓練分配給多位專家,MoE 可以更有效地利用硬件資源,減少總體計算需求并降低成本。

復雜性和研究: MoE 正迅速成為一種流行的方法,既能保持模型大小易于管理,又能涵蓋廣泛的主題。實施 MoE 需要仔細的配置和專業知識。

5. 協作并利用開源工具:

利用開源工具:利用 TensorFlow 或 PyTorch 等提供高效 LLM 訓練功能的開源框架。

與研究機構合作:與可能獲得 LLM 培訓補貼計算資源的研究機構合作。

數據采集也可以增加 LLM 的培訓,讓我們看看數據要求及其相關成本。

數據要求和成本

數據是 LLM 的命脈。數據質量、數量和多樣性直接影響模型的有效性和準確性。收集、清理和管理這些數據需要大量成本。數據需要足夠龐大和多樣化,才能訓練出一個沒有偏見、可以在不同環境中推廣的模型。數據集創建過程涉及大量勞動力,包括人工任務,例如監督學習場景的標記,這增加了成本。

然而,這些數據并非免費提供,有效管理這些數據會大大增加總體成本。以下是法學碩士數據管理的主要財務方面的細目:

數據獲取:獲取 LLM 培訓數據的主要方式有兩種:購買現有數據集或授權訪問它們。知名研究機構和私營公司通常會整理和出售專門用于訓練 AI 模型的文本和代碼數據集。這些數據集可能非常昂貴,具體取決于其大小、領域特異性和質量。

數據存儲:存儲海量數據集需要大量存儲容量。傳統的本地存儲解決方案維護和擴展成本高昂。云存儲服務提供了更靈活且更具成本效益的替代方案,但持續的存儲費用會隨著時間的推移而累積,尤其是對于 TB 或 PB 級的數據集。

數據預處理:原始數據很少以其原始形式用于 LLM 培訓。它通常需要大量的清理、標記和格式化。這種預處理可能涉及:

清理:刪除不相關的信息(如代碼注釋、HTML 標簽或重復條目)可能是一項計算量很大的任務,尤其是對于大型數據集而言。

標記:根據訓練目標,可能需要用特定類別或信息標記數據。這可能是一個需要人力的勞動密集型過程,也可以使用專門的工具自動完成,但會產生軟件許可成本。

格式化:確保數據具有適合 LLM 培訓的一致格式可能涉及額外的處理和潛在的定制軟件開發。

此外,負責任地處理此類數據以遵守隱私法和道德標準會帶來額外的復雜性和費用。數據匿名化、安全存儲以及遵守法規可能會增加任何 AI 項目的管理成本。

優化這些數據管理流程對于成本控制至關重要。數據選擇(僅使用相關子集)和遷移學習(利用預訓練模型)等技術可以幫助減少對大量昂貴數據集的依賴。

通過實施這些策略,研究人員和開發人員可以顯著降低 LLM 培訓成本。精心優化模型、利用高效的硬件和云服務以及采用節省成本的培訓配置對于管理 LLM 開發的財務負擔都至關重要。